この記事は元々掲載されました サイバーセキュリティダイブ。

最新の脅威ハンティングのためのデータ中心の基盤

サイバーセキュリティでは、AIは脅威ハンティングの未来だと言われています。しかし、隠れた秘密は、ほとんどのAIが片手を後ろで縛られたまま動作しているということです。 研究者たちは議論している AIモデルの良し悪しはデータパイプライン次第だとその原則は学術的な機械学習にとどまりません。これはサイバーセキュリティにも同様に当てはまります。AI、自動化、またはそれらを活用した脅威ハンティング 人体調査 その基盤となるデータインフラの性能に左右されます。

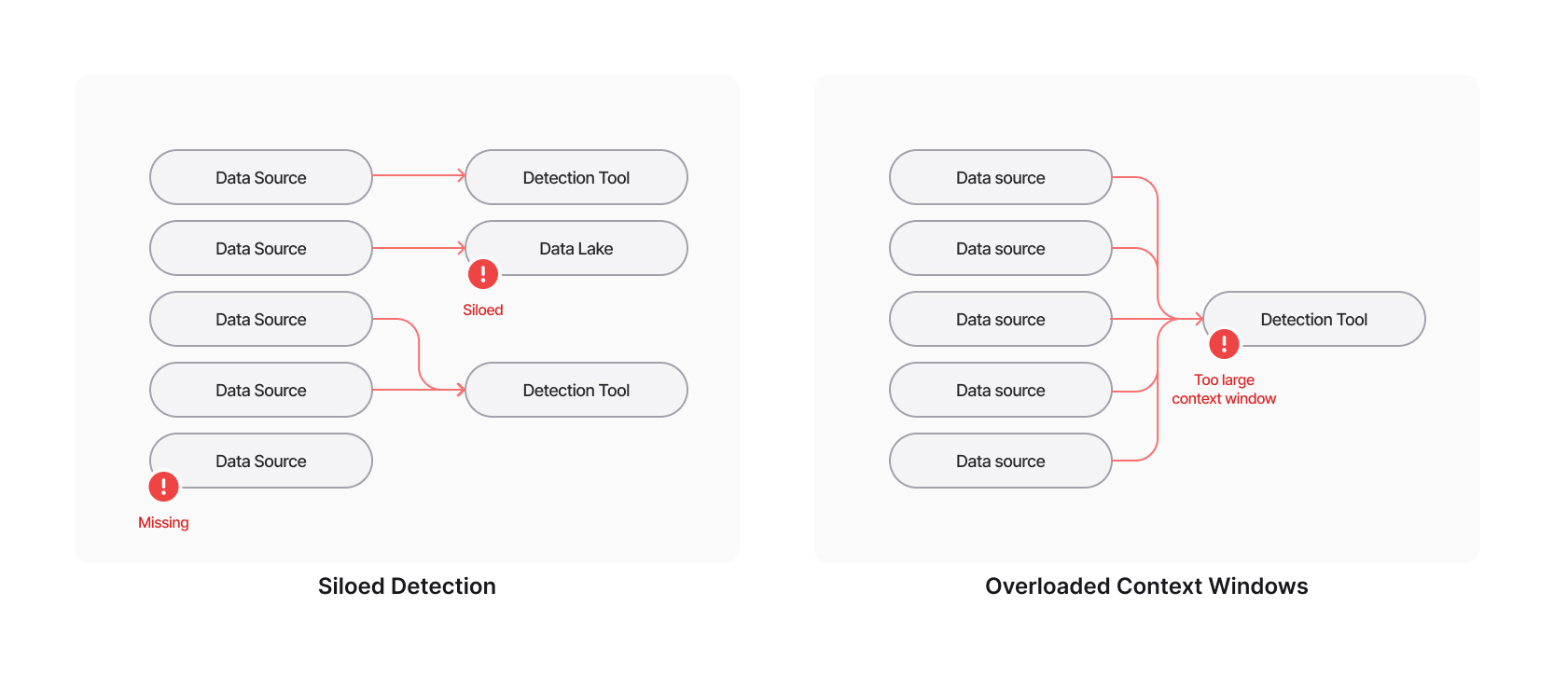

セキュリティチームは、より根本的な問題であるデータそのものに対処せずに、既存のデータレイクの上にAIを構築したり、新しい検出モデルをチューニングしたりすることに集中することが多すぎます。テレメトリがエンドポイント、クラウド、アイデンティティ、SaaS、コードリポジトリなどの切り離されたシステム間でサイロ化されていると、アナリストは断片からコンテキストをつなぎ合わせることになります。適切な変換を行わずにすべてのデータを同じプラットフォームに投入すると、 人間と人工知能の両方を圧倒する。最も高度なアルゴリズムでも 不完全または一貫性のないデータを克服できない。不十分なインプットで学習したり操作したりする AI は、常に質の低い結論を導き出します。人間主導の AI による脅威ハンティングも例外ではありません。

統合データが重要な理由

統一された相関データプラットフォームは、状況を変えます。すべてのデータを 1 か所にまとめると、ノイズが減り、個々のシステムではわかりにくいパターンを確認できるようになります。また、この情報を事前に変換して相互に関連付けることで、大規模な言語モデルやその他の AI 主導のツールでより使いやすくなります。構造やコンテキストを理解しようとして計算能力やトークンを無駄にするのは、コンテキストが間違っていたり、大きすぎたりすると結果が悪くなることが多く、AI は実際の行動の理解に集中できます。

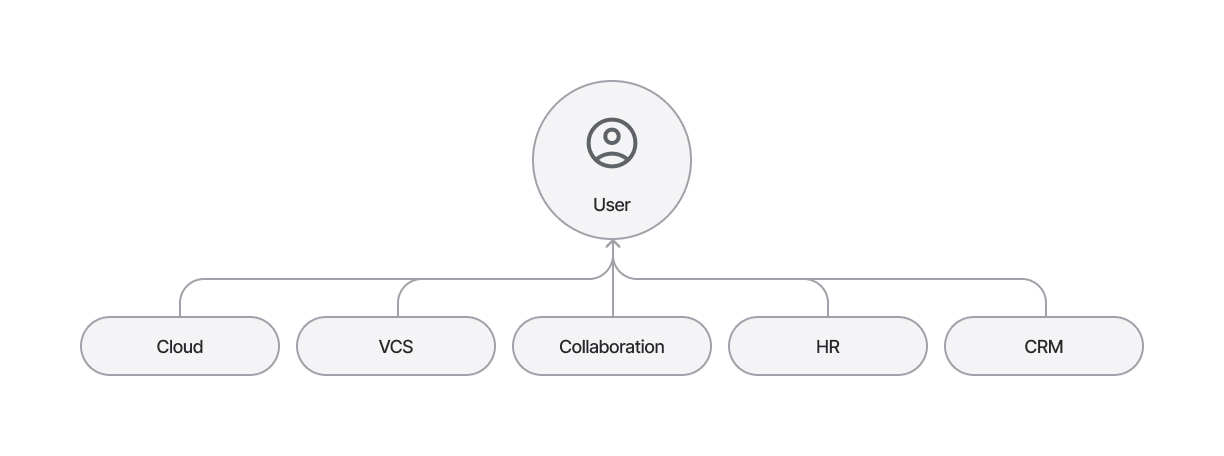

また、データを統合することで、つながったアイデンティティを自然に出現させることもできます。1 人のユーザーが AWS では IAM プリンシパル、GitHub ではコミッター、Google Workspace ではドキュメント所有者として表示される場合がありますが、これらはすべてまったく異なる名前で表示されます。これらのシグナルのいずれかを調べても、真実はほんの少ししかわかりません。それらをまとめて見ると、行動が明確になります。 何十ものファイルをダウンロードする from Google Workspaceは単独では疑わしいように思えるかもしれませんが、その同じIDが数分後にパブリックS3バケットを作成し、数十のリポジトリを個人のラップトップに複製した場合、そのアクティビティは明らかに悪意のあるものになります。

相関関係による脅威ハンティング

ログ、構成、コードリポジトリ、ID システムからのデータがすべて 1 か所にあると、かつては何時間もかかっていたり、不可能だった相関関係がすぐにわかります。たとえば、盗まれた短期間の認証情報に依存するラテラルムーブメントは、検出される前に複数のシステムを横断することがよくあります。侵害された開発者用ラップトップは、複数の IAM の役割を引き受け、新しいインスタンスを起動し、内部データベースにアクセスする可能性があります。エンドポイントのログからローカルの侵害が明らかになりますが、IAM とネットワークデータがなければ、侵入の範囲を証明する方法はありません。

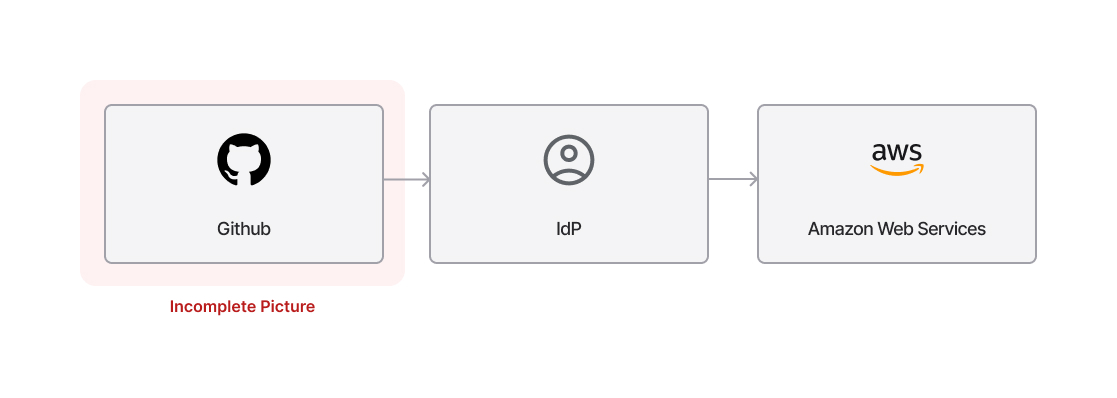

同様に、攻撃者が侵害された GitHub Action トークンを使用してクラウドにシャドウ管理者アカウントを作成しても、CI/CD ログを設定や ID の変更に関連付けない限り、攻撃者は気付かれません。また、OAuth スコープの範囲が広すぎるサードパーティアプリが、侵害を受けたユーザーアカウントを通じてデータを流出させた場合、統一された SaaS アクセスログと OAuth 同意履歴のみが真のベクトルを明らかにできます。

これらは抽象的な仮説ではありません。Salesloft/Driftの侵害は、攻撃者が最初に侵害されたGitHubアカウントを介してアクセスし、次にDriftのAWS環境でOAuthトークンを取得する方法を示しました。このトークンを利用して、DriftとSalesforceの信頼できる統合を通じて、接続された何百もの顧客環境にアクセスしていました。フォレンジックチームが GitHub、アイデンティティ、クラウド環境全体のアクティビティを相互に関連付けるまでは、各プラットフォームのログは正常に見えたようです。

忠実性と決定論

データパイプラインの品質が、脅威ハンティングの正確さを直接左右します。正しく行えば、適切なデータパイプラインは忠実度を犠牲にすることなく重複を減らし、ひいてはコストも削減します。AI 主導のシステムでは、確率的な推測ではなく、その忠実度によって決定論的な答えが導き出されます。データ品質の向上は、アーキテクチャの微調整よりも AI のパフォーマンスに大きな影響を与えます。検出と対応についても同じことが言えます。

脅威ハンティングの本質は、正確な質問をして信頼できる回答を得ることです。接続された忠実度の高いデータ基盤がなければ、すべてのクエリが不完全になります。現代のセキュリティアーキテクチャでは、量よりも明確さを優先し、人間と機械の両方が単一の正確な情報源から業務を行えるようにする必要があります。

戦略的ストレージと AI への対応

また、脅威ハンティングプラットフォームでは、どのデータがホットストレージとコールドストレージに保存されているかを戦略的に判断する必要があります。すべてのログ、トレース、イベントを即座にクエリできる必要はありません。重要なのは、IDの変更、クラウド構成、ソース管理アクティビティに関する価値の高いテレメトリに容易にアクセスできる一方で、履歴データやシグナルの少ないデータを階層化してより深いフォレンジックに使用できることです。ストレージ戦略がスマートになればなるほど、アナリストやモデルは無関係なノイズで計算量やコストを無駄にすることなく、より迅速に対応できるようになります。

データをすべて 1 か所にまとめると、本質的に LLM ユースケースへの対応も容易になります。堅牢なデータパイプラインは、効果的なコンテキストエンジニアリングの一形態です。として Anthropicのエンジニアが示したのは、最高のAI成果は、適切なデータを適切なタイミングで、適切なコンテキストで提供するが、多すぎないプラットフォームから得られます。モデルに構造化された関連性の高い一連の情報を提供することで、不必要な詳細に溺れたり、重要な事実が不足したりすることなく、問題を突き詰めることに集中できます。これは人間にとっても同じです。優れたアナリストであっても、ノイズに圧倒されたり、コンテキストが不足したりすると、効果を失います。データパイプラインがコンテクストに即した精度になるように設計されていれば、AI 脅威ハンティングは真に規模を拡大できます。

インサイトを有利に変える

敵の動きがかつてないほど速くなっている中で、勝つのは、環境全体をリアルタイムで把握できる組織です。脅威ハンティングのための AI 対応データプラットフォームを構築するには、検出速度だけでなく、不確実性を理解に変えることが重要です。統一されたデータは統一されたビジョンを意味し、統一されたビジョンは積極的な防御の基盤です。データエンジンが忠実度、スケール、AI 対応に合わせて調整されていれば、脅威ハンティングはより鋭く、より速く、より正確になります。